Iñaki Alegria Loinaz

Ez badirudi ere, adimen artifiziala (AA) kontzeptu zaharra da, konputagailuen eta informatikaren hasieratik erabili den kontzeptua baita. Kalkulu matematikoetarako gaitasuna eta sailkatzeko gaitasuna izan ziren informatikaren hasieran ustiatu zirenak eta, ondorioz, geroxeago sortu zen adimen artifizial kontzeptutik kanpo geratu ziren.

AA terminoa definitzeko bi ikuspuntu desberdin erabili ohi dira: batetik hurbilpen teorikoa, giza adimena simulatuz egindako aplikazioak-eta (arazo handi batekin, ez baitzekiten, eta oraindik ez dakigu, oso ondo nola funtzionatzen duen giza adimenak); eta bestetik hurbilpen praktikoa, ordura arte konputagailuek gizakiek baino okerrago egiten zituzten problemak garaiko adimen artifizialaren eremuan sartuta. Itzulpengintza automatikoa eta xake jokoa izan ziren urte askotan adimen artifizialaren barruan ikerketa egiteko esparru entzutetsuenak. 1980ko hamarkadako garai hartan Turingen testa ere[1] asko aipatzen zen, zeinaren bidez giza epaileak saiatzen baitira bereizten ea erantzun bat gizaki batek ala makina batek emandakoa den. Programaren emaitzak pertsonenak bezain sinesgarriak direnean programak portaera adimenduna duela ondorioztatzen da.

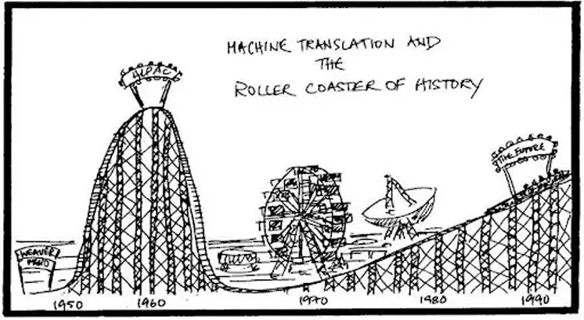

Itzulpengintza automatikoaren (IA) garapena ere aspalditik dator. Hasierako emaitza batzuek optimismorako joera piztu zuten 1960ko hamarkadan, geroago beteko ez ziren itxaropenak eraginez (errusiar mendiarekin irudikatzen dira orduko itxaropenen eta diru-inbertsioen gorabeherak).

Hala ere, pixkanaka, eta batez ere helburu zehatzetarako erabilita, sistema arrakastatsu batzuk (Quebeceko Meteo sistema esaterako, 1981-2001) lortu ziren. RBMT (erregelatan oinarritutako IA)[2] teknologiarekin nahiko ondo bermatzen zen fidagarritasuna, baina naturaltasunaren aldetik huts egiten zuten. Turingen testa gainditzera nekez iristen ziren sistema haiek, eta horregatik edo azpilengoaiaren batean espezializatzen ziren edo tipologia bereko bi hizkuntzen arteko itzulpenean zentratu. Bestalde, oso sistema konplexuak bihurtzen ziren, eta zerbait zuzendu nahi zenean aldi berean beste zerbait okertzen zen. Dire quasi la stessa cosa liburuan Umberto Ecok sistema horien gabeziak erabiltzen dituitzulpengintzaren zailtasunak azaltzeko. 2011n Kataluniako El Periódico itzulpen automatikoaren laguntzarekin bi edizio (katalanez eta gazteleraz) argitaratzen hasi zenean piztu zen Euskal Herrian antzeko zerbait egiteko sukar moduko bat, baina euskararen eta gaztelaniaren tipologien arteko aldea dela-eta ezinezkoa zen hori kalitate minimo batekin egitea.

Ondo egiten ez zuten sistema horiek bi helbururekin erabili dira urtetan zehar:

- Laguntza moduan, itzulpenaren lehen bertsio bat lortzeko, gero postedizio lana egiteko. Kalitate harekin itzultzaile profesional askok ez zuten erabiltzen, laguntza baino trabatzat hartuta, baina itzultzen adituak ez zirenentzat lagungarriak ziren.

- Interneteko zabalkundearekin batera, jakiteko gutxi gorabehera zertaz doan beste hizkuntza batean dagoen testu bat. “Bestela itzuliko ez liratekeen testuen” bertsio bat lortzen da horrela. Asimilazioa deitu ohi zaio erabilera horri.

Horrekin batera testu itzuliak biltzeko eta partekatzeko aukera asko zabaldu zen, eta hortik etorri zen itzulpen-memorien loraldia, eta IA estatistikoaren hasiera. IA estatistikoa (SMT, 2005)[3] IA neuronalaren aurrekaria izan zen, garai hartan oraindik garatu gabe baitzeuden neurona-sareak IAra egokitzeko behar ziren aurrerapen teknikoak eta konputazio-ahalmena. Horiek garatu zirenean etorri ziren IA neuronalaren (NMT, 2015) lehen sistemak[4]. Horretan guztian software librearen erabilera funtsezkoa izan zen, bestela garapena askoz motelagoa izango baitzen.

Kalitatearen aldetik NMT teknologia iraultza izan zen: RBMT sistemek huts egiten zuten esparruan NMT oso ona zen, naturaltasuna baita teknologia berri horren ezaugarririk behinena. Sistema horiek lehenik eta behin idazten ikasten dute, hizkuntzaren jarioaz jabetzen, eta gero hizkuntzen artean transferentzia egiten. Gauzak horrela, fidagarritasunean arazoak dituzte oraindik, eta hori oso arriskutsua da, ondo aztertu (posteditatu) gabe hanka sartze esanguratsuak sor baititzakete.

NMT sistemek, orokorrean, kalitate handia eskaintzen dute, baina, bestalde, teknologia konplexu eta garestia darabilte. Hori dela-eta enpresa handien eta inbertsio-funtsen eremua bihurtu dira, eta horren ondorioz arloko merkatuaren baldintzak aldatu dira (beste esparru batzuetan Amazon edo Uberrekin gertatu zen bezala). Gero eta ohikoagoa da itzulpengintzan ere plataformak izatea irabazle handienak, ohiko langileak prekarizatzen diren neurri berean.

Itzultzaileak halako krisian murgilduta zeudela, adimen artifizial testu-sortzailea (LLM, hizkuntza-eredu handiak, 2022) iritsi da. 2022ko azaroaren 30a jende askoren gogoan geratu da, egun horretan ChatGPT zabaldu zelako. Geroago beste batzuk agertu dira: Claude, DeepSeek, Perplexity… Halako programek testuak sortzeko eta galderei zein aginduei (itzultzeko aginduei ere) erantzuteko duten gaitasun izugarriak beste arlo asko irauli ditu: zuzenbidea, zuzenketa, kazetaritza… Itzulpengintzan ere ondo aritzen dira tresna horiek guztiak. NMTk baino are baliabide eta inbertsio handiagoa eskatzen dute eta ondorioz enpresa ahaltsuagoen mende daude. Areago, antzeko teknologiek iraultza ekarri dute irudi, bideo edo musika arloetan ere.

Gogoeta honen helburua ez da “askoren mina, zoroen atsegina” eragitea, baina jabetu behar gara itzultzaileenarekin batera beste lanbide asko krisian daudela teknologia berri hauek direla-eta. Jokalari handi horien guztien aurka egitea zaila da, baina herritarrek aldarrikatu behar dugu gure erakundeek jokalari horien gehiegikerietatik babestu behar gaituztela, burujabetza teknologikoa eta datuen babesa sustatuz, oligopolio horren gehiegizko boterea murriztuz, eta produktibitatearen handitzeak denon onerako bideratuz. Itzulpengintzaren arloan, eta bereziki euskara tartean dagoenean, zeregin handia dute gure erakundeek: kalitatea eta bidezko praktikak bultzatzea eta gehiegikeriak debekatzea eta zigortzea.

Itzulpengintza automatikoaren tresnen kalitateari begira zalantzak daude zein teknologiak eskaintzen duen kalitate handiena, NMT ala LLM. Sistema biek emaitza onak ematen dituztela onartuta[5], batzuek argudiatzen dute LLMren emaitza gertuago dagoela giza itzultzaileek sortutakotik, baina baliabideak urriak direnean[6], badirudi NMT teknologiak emaitza hobeak lortzen dituela. Bestalde, merkatu globalean eskuragarri dauden LLM sistemen artean, badirudi Claude besteen gainean dagoela itzulpenaren atazari dagokionez[7], eta euskararekin ere pertzepzio bera dut nik ere.

Amaitu baino lehen, goraipatu nahi dut Euskal Herrian burujabetza teknologikoari eta datuen babesari begira Hitz zentroak, Elhuyarrek eta Vicomtechek egiten duten lana. Ildo horretan software librean oinarritutako Latxa LLM sistema[8] bultzatzea izan daiteke etorkizunari begira apustu interesgarri bat.

[1] https://eu.wikipedia.org/wiki/Turingen_testa

[2] https://eu.wikipedia.org/wiki/Erregeletan_oinarritutako_itzulpen_automatikoa

[3] https://eu.wikipedia.org/wiki/Itzulpengintza_automatikoaren_historia

[4] https://eu.wikipedia.org/wiki/Itzulpen_automatiko_neuronal

[5] https://aclanthology.org/2024.wmt-1.116/

[6] https://aclanthology.org/2025.r2lm-1.13.pdf